产品介绍

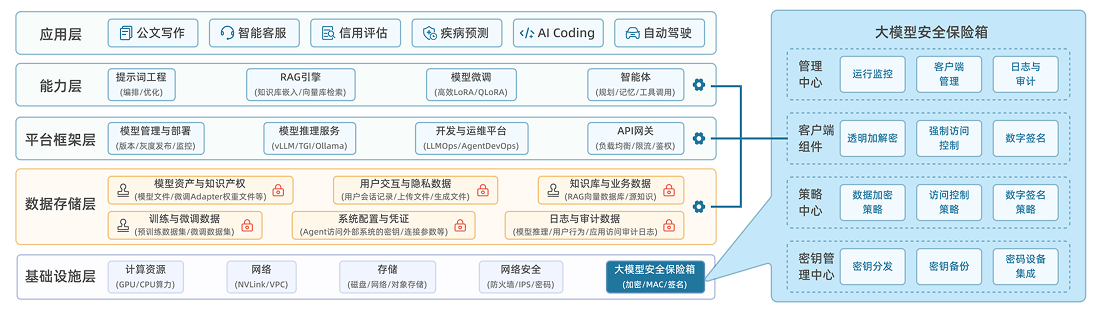

格尔AI大模型安全保险箱通过存储层自动化透明加密、强制访问控制与数字签名技术,为模型文件、知识库及用户交互数据建立 “可用不可见、可见不可复制”的防护体系,从根源上阻断模型资产窃取与数据泄露风险,为AI核心资产提供从存储、访问到使用的全生命周期安全保障。

产品部署

产品功能

- 管理控制台:提供统一控制台,集中管控客户端入网、状态、管理及日志审计。

- 密钥管理:管理三层密钥架构,对接HSM保障根密钥安全,负责密钥生成、分发与销毁。

- 策略中心:加密策略、访问控制策略和签名策略统一管理,一键同步。

- 客户端组件:部署于AI应用节点,通过底层驱动无感管控,实现AI业务零改造安全加固。

产品特点

- 业务改造,开箱即用

- 内核级强制访问控制

- 多层秘钥保护

- 合规一步到位

- 生态广泛兼容

- 高性能,GPU零损耗

应用场景

- 场景一:大模型厂商与开发者模型资产防窃取保护

面临挑战:大模型交付上线后,面临内部复制、外部窃取和篡改替换的风险,导致知识产权流失与模型服务失控等问题。

解决方案:利用加密、强制访问控制和数字签名技术对大模型文件存储加密,仅限授权进程可加载模型,并验证模型完整与来源可信,形成贯穿存储、加载与运行保护体系。

价值体现:从根源上防止模型权重等知识成果被非法复制、篡改或“白盒化”。

- 场景二:大模型用户敏感数据防泄漏保护

面临挑战:企业使用大模型时,对话记录、知识库等数据存储在数据库或文件中,一旦因内部越权或外部攻击泄露,将导致严重安全事件。

解决方案:对大模型会话记录、交互文件等实施文件级透明加密,确保所有敏感数据落盘即密文。对不同的Al进程制定差异化的访问策略,确保各进程仅能访问其必需的数据,杜绝内部越权。

价值体现:有效降低数据泄露风险;满足等保2.0、《数据安全法》及密评等合规要求。

- 场景三:大模型厂商与开发者模型资产防窃取保护

面临挑战:企业将敏感数据和模型托管于平台,担忧资产被窃或泄露;平台方面临内部越权、外部攻击导致数据泄露与合规审计的风险。

解决方案:将大模型安全保险箱作为平台安全能力部署,租户模型文件存储自动加密;为模型文件等关键资产施加数字签名,防篡改、可溯源。

价值体现:企业租户:提供“可自证”的数据主权,打消托管顾虑;平台方:构建“零信任”底座,化解数据泄露与合规风险。